Ewolucja komputerów osobistych na przestrzeni lat

W 1977 r. niewielka firma Apple zaskoczyła rynek, demonstrując mieszczący się na biurku komputer Apple II, którego obsługa nie wymagała dużej fachowej wiedzy. „Nie ma powodu, dla którego ktokolwiek miałby mieć komputer w swoim domu” – stwierdził w 1977 r. Kenneth Olsen, założyciel legendarnej firmy komputerowej Digital Equipment Corporation (DEC), przez wiele lat największego konkurenta IBM.

DEC już nie istnieje, a komputery stały się częścią wyposażenia setek milionów domów na całym świecie.

Mikroprocesor

Olsen, skądinąd doskonały wynalazca i przedsiębiorca, nie wyciągnął wniosku z innej, trafniejszej przepowiedni Gordona Moore’a, specjalisty w dziedzinie półprzewodników, który napisał w 1965 r. w „Electronics Magazine”, że stopień złożoności elektronicznego układu scalonego w stosunku do stałej ceny podwaja się co 24 miesiące. Złożoność, czyli liczba komponentów, takich jak tranzystory, umieszczonych na powierzchni krzemowej płytki, wzrasta w tempie wykładniczym, czyniąc tym samym układ wydajniejszym.

Spostrzeżenie to przeszło do historii pod nazwą prawa Moore’a, które do dziś poprawnie opisuje tempo rozwoju technologii półprzewodnikowych. Moore jednak zasłużył na pamięć potomnych głównie z innego powodu. W 1968r. założył z Robertem Noycem (jeden z wynalazców układu scalonego) firmę Intel. W listopadzie 1971 r. Intel zaprezentował kolejny przełomowy dla rozwoju mikroelektroniki wynalazek, który wieńczył rewolucję zapoczątkowaną przez tranzystor i kontynuowaną przez opracowanie układu scalonego.

Mikroprocesor Intel 4004

Nowy produkt o nazwie Intel 4004 był pierwszym mikroprocesorem, czyli scalonym układem elektronicznym, zdolnym do wykonywania funkcji komputera. Maleńka krzemowa kostka zastępowała olbrzymie urządzenia wypełnione tysiącami lamp elektronowych. Niemal w tym samym czasie mikroprocesor został zaprezentowany przez inną amerykańską korporację Texas Instruments. Spór o pierwszeństwo wynalazku trwał wiele lat, nie chodziło w nim tylko o prestiż, ale głównie o pieniądze – zwycięzca mógł żądać od innych producentów mikroprocesorów tantiem.

W 1971 r. trudno było jeszcze w pełni zrozumieć znaczenie mikroprocesora. Trzy lata później na okładce hobbystycznego magazynu „Radio-Electronics” pojawiło się zdjęcie urządzenia o nazwie Mark 8 (zaprojektował je Jonathan Titus) i hasło: „Zbuduj Mark 8, twój osobisty minikomputer„. Pismo zachęcało do zakupu płyty zawierającej kolejny już mikroprocesor Intela, oznaczony liczbą 8008, i złożenie komputera z dostępnych w sklepach podzespołów. Pomysł ten zainspirował wydawcę innego czasopisma, „Popular Electronics”, by zaproponować hobbystom „minikomputer w częściach”, łatwiejszy do samodzielnego złożenia w domu niż Mark 8.

Altair 8800 i kontrkultura

W styczniu 1975 r. „Popular Electronics” rozpoczął akcję sprzedaży zestawów dla majsterkowiczów, zawierających mikrokomputer Altair 8800 projektu Edwarda Robertsa, współwłaściciela firmy MITS, wyposażony w najnowszy mikroprocesor Intela 8080. Urządzenie miało niewiele wspólnego z dzisiejszymi komputerami osobistymi – było pudełkiem z kolorowymi lampkami na panelu głównym, pozbawionym monitora i klawiatury.

Mimo tej toporności popyt na Altaira przekroczył wszelkie oczekiwania. Firma Robertsa, mały warsztat na przedmieściach Albuquerque, nie nadążała z produkcją setek zamówionych zestawów. Hobbyści musieli czekać w kolejce po wiele miesięcy, najbardziej niecierpliwi jechali do Robertsa i koczowali pod drzwiami jego warsztatu. Już kilka miesięcy po premierze Altaira na rynku pojawiła się konkurencja w postaci komputera IMSAI 8080. Potem do wyścigu zaczęli włączać się kolejni producenci.

Mimo swej technicznej niedoskonałości Altair 8800 wymieniany jest jako urządzenie, które zainicjowało rewolucję komputerów osobistych. Na miano to zasługuje choćby dlatego, że spełniał pragnienie posiadania „prywatnego mózgu elektronowego”. Wcześniej dostęp do komputerów i ich zdolności obliczeniowych mieli tylko przedstawiciele establishmentu: wojska, agencji rządowych, banków, instytutów naukowych. Komputer w wojsku utrwalił się w pamięci jako narzędzie militarnej przemocy podczas wojny Stanów Zjednoczonych z Wietnamem.

Zaawansowane technologie jednoznacznie kojarzyły się z władzą i przemocą, określając jednocześnie program dla wielu aktywistów ruchów kontrkulturowych bujnie kwitnących na przełomie lat 60. i 70. Czy istnieje lepszy sposób na przeciwstawienie się establishmentowi niż opanowanie atrybutów jego mocy?

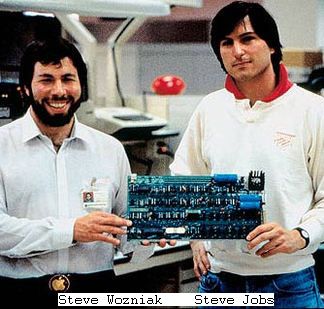

Steve Jobs i rewolucja komputerów

W nasyconej marihuaną i LSD atmosferze kalifornijskiego buntu wyrastał m.in. Steve Jobs, krnąbrny nastolatek przekonany bezwzględnie o swoim technicznym geniuszu. Równie silnie zafascynowany buddyzmem zen jak i elektroniką, w 1974 r. zatrudnił się w firmie Atari produkującej gry wideo. Nieco później pojechał w podróż inicjacyjną do Indii i wrócił na czas, by nie przegapić nadchodzącej rewolucji. W odpowiedzi na akcję „Popular Electronics” i Altaira 8800 powstał w Kalifornii Homebrew Computer Club – klub amatorów komputerów, który pomagał swoim uczestnikom zdobyć dostęp do upragnionej mocy obliczeniowej.

W nasyconej marihuaną i LSD atmosferze kalifornijskiego buntu wyrastał m.in. Steve Jobs, krnąbrny nastolatek przekonany bezwzględnie o swoim technicznym geniuszu. Równie silnie zafascynowany buddyzmem zen jak i elektroniką, w 1974 r. zatrudnił się w firmie Atari produkującej gry wideo. Nieco później pojechał w podróż inicjacyjną do Indii i wrócił na czas, by nie przegapić nadchodzącej rewolucji. W odpowiedzi na akcję „Popular Electronics” i Altaira 8800 powstał w Kalifornii Homebrew Computer Club – klub amatorów komputerów, który pomagał swoim uczestnikom zdobyć dostęp do upragnionej mocy obliczeniowej.

Jobs wspólnie z innym poznanym wcześniej elektronicznym geniuszem Stevem Wozniakiem postanowili nadać rewolucji komputerów osobistych nową treść. Zaczynając w garażu skonstruowali najpierw komputer Apple I, który choć nawiązywał do hobbystycznego modelu zainicjowanego przez Altair 8800, wyposażony był w znacznie doskonalsze, zaprojektowane przez Wozniaka, rozwiązania elektroniczne.

Potem przyszedł czas na coś naprawdę poważnego – maszynę Apple II zaprezentowaną w 1977 r., kiedy wspomniany na początku Ken Olsen nie widział powodu, by kupować komputery do domu.

Funkcjonalność komputerów

Apple II olśnił publiczność zarówno swoim wyglądem, jak i funkcjonalnością. Gdy firma Apple zaoferowała klientom zakup takich programów użytkowych jak procesor tekstu Apple Writer i arkusz kalkulacyjny VisiCalc – stało się jasne, dlaczego warto mieć komputer.

Otwierał możliwości, jakich nie zapewniała ani klasyczna maszyna do pisania, ani skomplikowany nawet kalkulator. Apple II szturmem zdobył gabinety biznesmenów i wkrótce wkroczył do amerykańskich szkół. W1979 r. Jobs i Wozniak sprzedali część udziałów firmy, by stać się milionerami.

Otwierał możliwości, jakich nie zapewniała ani klasyczna maszyna do pisania, ani skomplikowany nawet kalkulator. Apple II szturmem zdobył gabinety biznesmenów i wkrótce wkroczył do amerykańskich szkół. W1979 r. Jobs i Wozniak sprzedali część udziałów firmy, by stać się milionerami.

Powstanie Microsoft

W tym samym czasie, do skoku szykował się inny wizjoner i geniusz biznesu. Znowu należy jednak wrócić do źródeł, czyli komputera Altair 8800. Jednym ze sposobów ułatwienia komunikacji z toporną maszyną mogło być wyposażenie jej w możliwość programowania za pomocą tzw. języka wyższego rzędu. Najbardziej popularny był język programowania BASIC, który umożliwiał przygotowywanie programów sterujących komputerem za pomocą tekstu zbliżonego do zwykłej angielszczyzny.

Pewnego dnia twórca Altaira otrzymał propozycję z Seattle, w której dwaj nieznani mu osobnicy, Paul Allen i William Gates, zaproponowali, że przygotują tzw. interpreter BASIC dla tego komputera. Oferta została przyjęta, choć chłopcy z Seattle grali va banque, nie mając jeszcze gotowego produktu. Paul Allen dokonywał ostatnich poprawek w samolocie z Seattle do Albuquerque. Po instalacji maszyna ożyła, potwierdzając gotowość słuchania poleceń w BASIC. Po to, by zainkasować pieniądze od Edwardsa, Allen i Gates założyli firmę o nazwie Micro-Soft (dziś Microsoft).

Kontrakt, jaki młody (dwudziestoletni wówczas Gates) podpisał z Edwardsem, stał się fundamentem rozwoju przemysłu oprogramowania komputerowego. Daniel Ichbiah, biograf Gatesa, wspomina w książce „Microsoft story” ustalone wówczas zasady: „…interpreter BASIC pozostaje własnością Microsoftu. MITS ma wyłączność na rozprowadzanie, lecz jest to tylko prawo do sprzedaży. Za każdy sprzedany egzemplarz MITS będzie płacić Microsoftowi 35 dol. W kontrakcie sprzedaży zastrzeżono również, że producent sprzętu czy jego nabywca nie stanie się nigdy właścicielem programu, lecz tylko jego użytkownikiem: prawo własności ma Microsoft”.

Tak jest do dzisiaj – kupując pakiet Microsoft Office nabywca dostaje jedynie prawo do korzystania z jego funkcji, samo oprogramowanie jest nadal własnością firmy – nie wolno go powielać, modyfikować ani odsprzedawać. Z kolei każdy sprzedany komputer, który jak pierwsze Altairy 8800 potrzebował interpretera BASIC, czy też system operacyjny jest „opodatkowany” na rzecz Microsoftu. Wkrótce z usług Microsoftu zaczął korzystać Apple i komputerowy gigant IBM. Każdy sprzedany komputer Jobsa, a potem PC IBM, przynosił zysk jego producentowi, a także opłaty licencyjne dla Gatesa, który w ten sposób rozpoczął oszałamiającą podróż, by stać się jednym z najbogatszych ludzi świata.

Pobudka giganta przemysłu komputerowego IBM

Rewolucja komputerów osobistych miała jeszcze dwa przełomowe etapy. Sukces Apple II boleśnie dotknął koncern IBM, giganta przemysłu komputerowego. IBM pod koniec lat 70. pogrążył się w kryzysie, świat się zmieniał i nie wystarczało już tylko produkować wielkie maszyny obliczeniowe.

Zarządzający molochem znali słabości jego bizantyjskiej struktury, które czyniły ją powolniejszą w konkurencji z małym i obrotnym przedsiębiorstwem, jakim był wówczas Apple. Zarząd firmy podjął w 1980 r. odważną decyzję, by w strukturze korporacji powstał niezależny dział, który dostał szeroką autonomię i straceńcze zadanie: opracować w ciągu roku komputer osobisty zdolny do podboju rynku. To zbyt mało czasu, by skonstruować nowe podzespoły w firmie, większość trzeba kupić u innych dostawców. Intel dostarczył mikroprocesor 8088, Microsoft zapewnił system operacyjny – słynny MS-DOS oraz wiele innych programów. Latem 1981 r. komputer PC IBM trafił na rynek – kosztował 1565 ówczesnych dolarów. Rozpoczęła się epoka pecetów.

Komputer w biznesie

IBM stworzył jednak nie tylko nowy komputer, ale także zapoczątkował nowy sposób uprawiania komputerowego biznesu. Wcześniejsza praktyka polegała na samodzielnym tworzeniu wszystkich elementów w ramach jednej firmy, co powodowało, że produkty firm konkurencyjnych nie mogły ze sobą współpracować, były niekompatybilne (tak jak niekompatybilny z PC IBM był Apple II). IBM zmienił zasady umożliwiając tzw. klonowanie, czyli produkcję komputerów podobnych do PC IBM przez innych producentów. W efekcie uruchomionej w ten sposób konkurencji znakomicie spadły ceny, a standard IBM zdominował świat. Najbardziej skorzystał na tym oczywiście Bill Gates i jego Microsoft.

Komputery Macintosh

Apple odpowiedział na kontratak IBM słynnym listem opublikowanym w formie ogłoszenia w „Wall Street Journal”, który zaczynał się od słów: „Witamy na tym najbardziej podniecającym i najważniejszym rynku od czasów powstania komputerów 35 lat temu”. A potem Jobs sam przystąpił do uderzenia. Inspiracją była wizyta w laboratorium koncernu Xerox w Palo Alto, gdzie Jobs wraz z inżynierami z Apple zobaczyli prototyp graficznego interfejsu użytkownika (czyli nowego sposobu porozumiewania się z komputerem, który nie wymagał pisania trudnych komend – ich miejsce zastąpiły znaki graficzne i myszka).

Oczywisty dziś sposób kontaktowania się z komputerem za pomocą grafiki był wówczas szokującym odkryciem. Ludzie z Apple zaadaptowali pomysł Xeroksa i 24 stycznia 1984 r. na rynku pojawił się nowy komputer o nazwie Macintosh. Premierze towarzyszyła przejmująca reklama telewizyjna autorstwa Ridleya Scotta, odwołująca się do George’a Orwella. Dzięki Macintoshowi rozpoczynający się 1984 r. miał nie stać się Orwellowskim „Rokiem 1984″.

Łatwiejsza obsługa komputera

Powstał komputer dla całej reszty, czyli dla tych, którzy nie mają kompetencji inżynierskich i nie chcą marnować czasu na uczenie się trudnych komend. John Battelle, badacz komputerowych subkultur, wspomina w książce „Szukaj” swoje pierwsze wrażenia z kontaktów z „makiem”: „Jak praktycznie każdy ówczesny użytkownik tego komputera, byłem zafascynowany działaniem interfejsu – wskazywałem tam i… tam coś się zmieniało.

Antropologia i technika zespoliły się, a ja szybko doszedłem do wniosku, że Macintosh reprezentuje najbardziej skomplikowany i najważniejszy artefakt w historii rodzaju ludzkiego: jest wizualnym uosobieniem plastycznego umysłu”. Znowu głównym wygranym był Bill Gates i Microsoft, odpowiedzialni za przygotowanie części oprogramowania dla nowego dziecka Apple.

Rok później firma Gatesa zaproponowała Windows – graficzną nakładkę na system operacyjny DOS, będącą kulawą imitacją graficznego środowiska Macintosha. Niemniej jednak w najbliższych latach rynek przyznał rację modelowi biznesowemu zaproponowanemu przez IBM i Microsoft, który umożliwił umasowienie produkcji komputerów osobistych.

30 mln komputerów

Komputer osobisty zmienił świat, stając się jedną z „technologii wolności”. Pojęcia tego użył w 1983 r. Ithiel de Sola Pool z Massachusetts Institute of Technology w książce „Technologies of Freedom”, w której wskazuje konsekwencje przekazania mocy obliczeniowych zwykłym ludziom.Komputery osobiste połączone ze sobą sieciami teleinformatycznymi (słowa Internet jeszcze się wówczas powszechnie nie używało) będą miały taki wpływ na społeczeństwo jak prasa drukarska Gutenberga.

Dynamika zmian w produkcji komputerów

Wraz z komputerem osobistym pojawiła się, dostrzeżona wyraźnie przez IBM, zmiana sposobu organizacji produkcji. Skończyły się czasy, kiedy jeden model komputera można było produkować przez 10 lat, cykl produkcyjno-innowacyjny nabrał niebywałego przyspieszenia. Zdaniem Manuela Castellsa, socjologa badającego rozwój społeczeństwa informacyjnego, to właśnie m.in. na skutek tej gwałtownej zmiany i przyspieszania innowacyjnego Związek Radziecki w latach 80. ostatecznie stracił możliwości konkurowania ze Stanami Zjednoczonymi.

W chwili upadku ZSRR w 1991 r. w komunistycznym imperium doliczyć się można było ok. 50 tys. komputerów osobistych. W USA było ich już 30 mln.